Nacido en Apolonia, un concurrido puerto comercial de Libia, Sexto Empírico fue la principal figura de la escuela escéptica de medicina a finales del siglo II de nuestra era. Él se consideraba escéptico, o pirrónico —en alusión a Pirrón de Elis (365-275 a. C.)—, porque mostraba una habitual, y a veces extrema, cautela antes de aceptar cualquier dato como verdadero.

En su faceta de médico forense, Sexto Empírico acuñó el término autopsia, que literalmente significa ‘mirar con los ojos de uno mismo’ y, en el terreno de la lógica, se opuso audazmente a Aristóteles. Su famoso y preclaro silogismo (argumento con tres proposiciones, dos antecedentes y un consecuente, de tipo deductivo, que empieza en un conocimiento general y acaba en uno particular; por ejemplo: “Todos los hombres son mortales. Sócrates es hombre. Ergo, Sócrates es mortal”) le parecía un laberinto de obviedades que no llevaba a ningún lado.

En Esbozos pirrónicos, obra que escribió en Alejandría y la más conocida entre las suyas, Sexto Empírico expuso la función lógica que gobernaría, en adelante, su proceder intelectual: la disyunción exclusiva. Al respecto, el filósofo anota: “la disyunción correcta expresa que sólo es verdadera una de sus apreciaciones y la restante o restantes, falsa o falsas en contradicción con ella”.[1] En una época más reciente, a finales de la década de los sesenta, Marvin Lee Minsky y Seymour A. Papert rescataron esa función lógica de las catacumbas grecolatinas y, usándola como infalible arma de ataque, pusieron en duda el potencial de las redes neuronales simples para resolver ciertos problemas, en específico aquéllos que se referían a la separabilidad lineal.[2]

En Perceptrons. An Introduction to Computational Geometry, Minsky y Papert arguyeron que las redes neuronales simples “parecen trabajar bien con pequeños problemas ‘de juguete’, pero que se vuelven absolutamente inútiles tan pronto como se enfrentan a problemas más grandes, incluso si son de la misma especie”.[3] El ejemplo más devastador que ellos invocaron fue, precisamente, el de la disyunción exclusiva de Sexto Empírico.

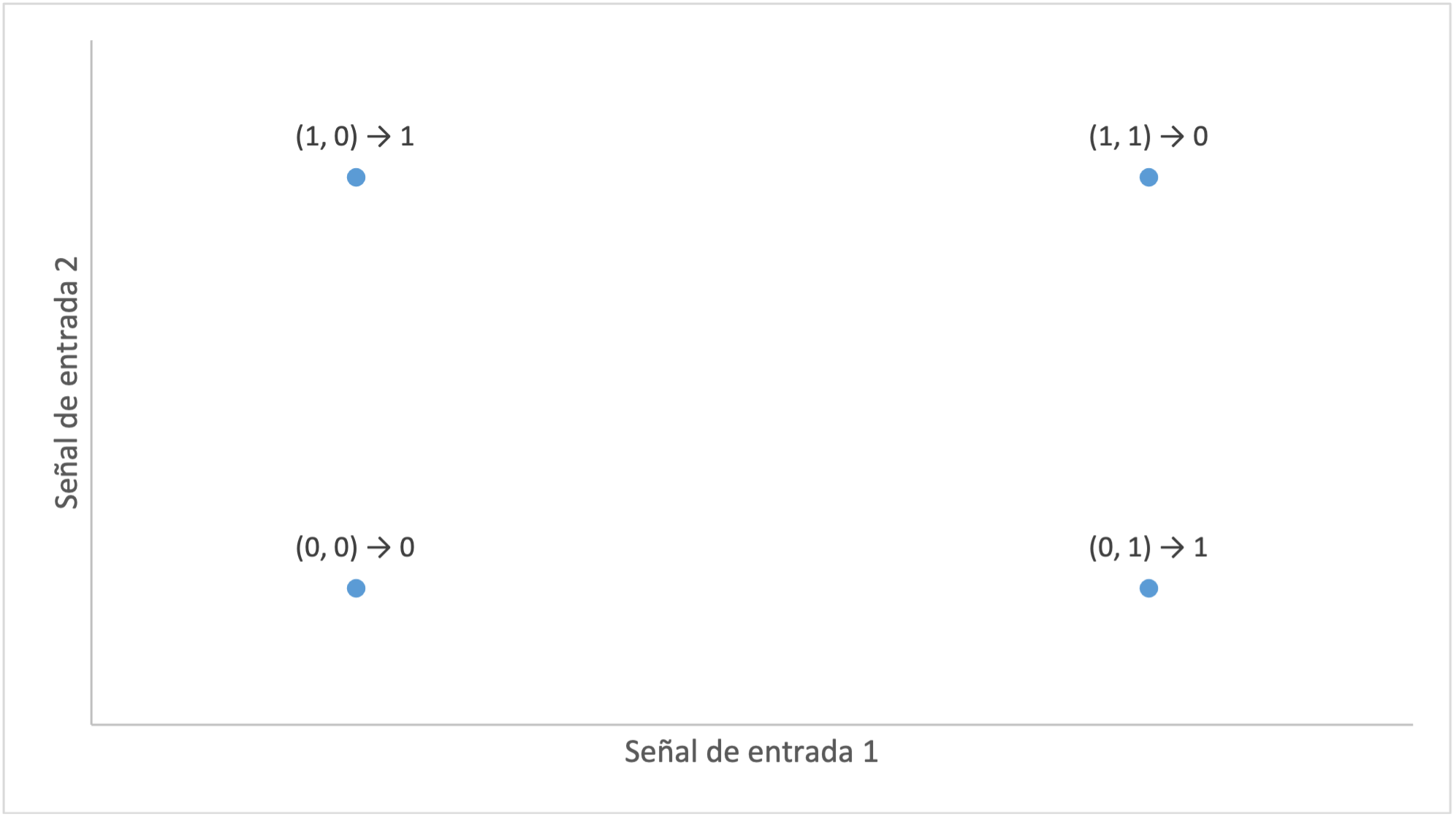

La disyunción exclusiva, conocida también con los nombres de or-exclusive o XOR, es una función lógica que obliga a seleccionar, como condición de verdad, una de dos opciones viables: o un sistema de escritura numérica es romano o arábigo, o un animal es vertebrado o invertebrado, o una forma de gobierno es democracia o dictadura, pero no pueden ser, en ningún caso, las dos a la vez. Según las enseñanzas de Sexto Empírico, aprender es una tarea que consiste en saber elegir, en cultivar las facultades del reconocimiento y de la clasificación. Esta tabla de verdad esquematiza tales aserciones:

| Señal de entrada 1 | Señal de entrada 2 | Señal de salida | |

| 0 | 0 | → | 0 |

| 0 | 1 | → | 1 |

| 1 | 0 | → | 1 |

| 1 | 1 | → | 0 |

Tabla de verdad de la función lógica disyunción exclusiva.

Una red neuronal simple que implemente el método de separabilidad lineal para clasificar los datos que están a su disposición no logrará representar, por más que lo intente, la disyunción exclusiva. En respuesta a la tentativa de aplicar esta función lógica, si el 0 simboliza a los números romanos, o a los vertebrados o a las democracias, y si el 1 hace lo propio con los número arábigos, o con los invertebrados o con las dictaduras, la red neuronal simple en cuestión los confundirá, colocando los ceros y los unos (con sus correspondientes referentes) en un solo lado de la línea de separación, cuando debería posicionarlos, más bien, en extremos opuestos: unos a la izquierda y otros a la derecha, unos abajo y otros arriba, unos en la esquina inferior interna y otros en la esquina superior externa o viceversa.

Representación gráfica de la función lógica disyunción exclusiva. Tal cual se comprueba en ella, resulta imposible trazar una línea recta, vertical, horizontal o diagonal, que separe y clasifique, por un lado, los valores de 0, y, por otro, los valores de 1.

Según una opinión muy extendida, el libro de Minsky y de Papert gozó de una extraordinaria acogida y propició que la investigación y el desarrollo de las redes neuronales simples entraran en suspenso durante prácticamente tres lustros, que se congelaran en el cruel invierno de la indiferencia y del desinterés académicos. Acerca del futuro de las redes neuronales simples, y de su hipotético mejoramiento por vía de la anexión de capas neuronales intermedias, Minsky y Papert fueron contundentes: “Tenemos el juicio intuitivo de que una mayor extensión [de capas neuronales intermedias] sería del todo estéril”.[4]

En 1986, sin embargo, David Everett Rumelhart, Geoffrey E. Hinton y Ronald J. Williams publicaron un artículo donde propusieron una serie de ideas revolucionarias: que las redes neuronales simples sí pueden aumentar de manera considerable su eficiencia si, en medio de las insípidas neuronas de entrada y de salida, se colocan una o más capas neuronales que intervengan y procesen la información transmitida, que sean modificables y regulables por un algoritmo y que sean capaces, sobre todo, de crear su propia “representación interna”.[5]

El artículo de Rumelhart, Hinton y Williams, así como la publicación en que apareció compendiado, Processing of Parallel Distribution. Explorations in the Microstructure of Cognition, dos volúmenes popularmente conocidos como PDP, reavivaron el interés por las redes neuronales artificiales. A partir de entonces, las investigaciones en la materia se han centrado en las redes neuronales multicapa y, gracias a esta nueva perspectiva, se han descubierto prometedores horizontes de oportunidad. A la fecha, las redes neuronales multicapa cuentan con un elevado grado de sofisticación y se rigen por principios bien determinados.

Francisco Gallardo Negrete

Doctor en Teoría Literaria y escritor.

[1] Sexto Empírico (1993). Esbozos pirrónicos (Antonio Gallego Cao y Teresa Muñoz Diego, trad.). Madrid: Gredos, p. 202; cursivas en el original.

[2] La separabilidad lineal es un método muy útil: una inteligencia artificial, cuando está dotada de una importante cantidad de datos, puede echar mano de él a fin de trazar una línea sobre el cuadrante de un plano cartesiano y así separar y clasificar, agrupándolos en vista de las semejanzas o de las desemejanzas de sus características, los datos.

[3] Lee Minsky, M. y Papert, S. (1988). Perceptrons. An Introduction to Computational Geometry. Massachusetts: The MIT Press, p. 249.

[4]Ibidem, p. 232.

[5] Rumelhart, D., Hinton, G. y Williams, R. (1999). “Learning Internal Representation by Error Propagation”. En David E. Rumelhart y James L. McClelland (coord.), Parallel Distributed Processing. Explorations in the Microstructure of Cognition. I. Foundations. Massachusetts: The MIT Press, p. 319.

Es un excelente resumen de la historia temprana del desarrollo de las redes neuronales en el siglo XX.

Un perceptrón (una sola neurona) no puede resolver el XOR (disyunción exclusiva) pero muchas neuronas colocadas en una sola capa pueden hacer particiones del espacio de búsqueda muy elaboradas combinando líneas rectas, del mismo modo que ocurre con el método de programación lineal. De este modo pueden representarse situaciones más complicadas que un sí o un no.

La falta de apoyos públicos para la investigación y la política del publicar o perecer han provocado que muchos investigadores decidan crear empresas tanto para implementar tecnología que han desarrollado como para allegarse recursos para seguir investigando. Aunque sí es necesario crear canales para que la investigación ayude al crecimiento económico, esta tendencia a pasar al sector privado tiene dos defectos:

1) Muchos problemas no se pueden resolver desde el sector privado. En el caso del desarrollo de antibióticos, al ser medicamentos baratos y eficaces, no es rentable para las farmaceúticas desarrollarlos (apenas el año pasado de desarrolló un nuevo antibiótico después de 30 años sin novedades). Son necesarios nuevos antibióticos porque las bacterias están desarrollando resistencia a los que ya tenemos.

2) Los investigadores empresarios suelen estar a la vanguardia de sus campos, pero también desarrollan conflictos de interés, aun teniendo las mejores intenciones.

Finalmente, estrictamente hablando se puede sacar los chips de procesamiento gráfico de las consolas de videojuegos y reprogramarlos para crear redes neuronales.

Este artículo es un excelente resume del desarrollo de las redes neuronales durante el siglo XX.

Es cierto que una sola neurona (un perceptrón) no puede resolver la operación lógica XOR, pero una capa de neuronas permite hacer una partición del espacio de bísqueda más complejo, de la misma manera que ocurre en el método de optimización de programación lineal.